こんにちは、ITプロマガジンです。

この記事では、よく使われているAIライブラリを紹介します。さらに、AI開発を検討している方に向けて、AIライブラリについても解説しているので、ライブラリを学びAIを使って問題を解決できるものがないか探している方は、参考にしてください。

「必要以上に安売りをしてしまう」「市場感より高い単価で参画してしまいトラブルになる..」

フリーランス市場は売り手市場であるものの、いまだに正しいノウハウが確立されておらず、多くの方が案件探しに苦労されています。

ですが、現在の市場感や企業側に刺さる経験・スキルを理解し正しく案件探しをすれば、誰でも自身のバリューを活かし単価を伸ばすことができる、というのも事実です。

ITプロパートナーズでは、

・9割がエンド直案件のため、高単価

・約6割が週3-4案件のため、柔軟に働ける

・約7割がリモートのため、働く場所を選べる

などの魅力的な案件を数多く保有し、マッチング能力の高い即戦力エージェントが完全サポートします。

初めてのフリーランス、情報収集段階でも大丈夫です。あなたの働き方にマッチし、単価も高く、最もバリューを発揮できる案件を探しませんか?

よく使われるAIライブラリ一覧

人工知能用ライブラリ・フレームワークの一覧をご紹介します。なお、今回、選んだものはすべてオープンソースのもので、誰でも無料で利用可能です。

- Caffe、Caffe2(カフェ)

- DL4J

- MXNet

- Chainer(チェイナー)

- Keras(ケラス)

- Torch(トーチ) 、Pytorch(パイトーチ)

- TensorFlow(テンソーフロー)

- PaddlePaddle(パドルパドル)

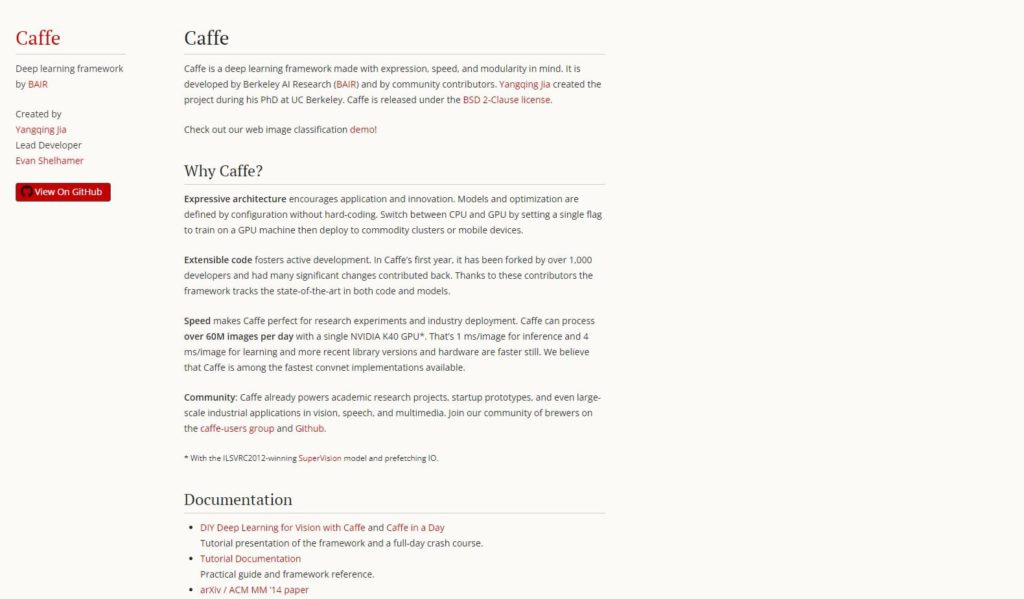

1.Caffe Caffe2(カフェ)

Caffeはカリフォルニア大学バークレー校で研究されていた人工知能フレームワークです。画像認識に特化しており、C++で記述されていることもあり処理が高速という特徴があります。また、開発元の方針もあり、開発者コミュニティーが非常に活発な点も特徴の一つに挙げられます。

Caffe2は、非常に優れたCaffeをFacebookとGeForceブランドのグラフィックボード(GPU)メーカーとして有名なNVIDIAが共同で発展させたライブラリです。もともとのCaffeもGPUに演算処理を行わせるGPGPUができるライブラリでしたが、Caffe2ではより効率よくGPGPUができるCUDAにも対応しています。

CUDAとはNVIDIAが開発・提供している並列処理用のアーキテクチャーで、NVIDIA製のGPUの性能を最大限に引き出すことが可能となります。反面、過度にCUDAに依存した人工知能にしてしますと、リプレース時などにNVIDIA製以外のGPUを選択しにくくなるという、いわゆるベンダロックインの原因にもなります。

もちろん、処理速度や開発者コミュニティーの活発さといった、Caffe時代から続くメリットも受け継いでいます。

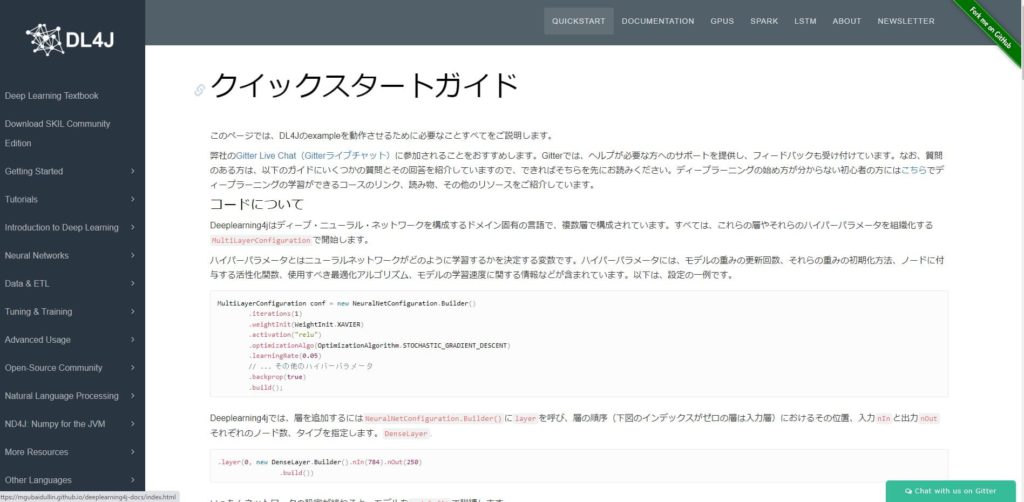

2.Deeplearning4j(DL4J)

Deeplearning4jはJavaで人工知能開発を考えている方であれば、絶対に外せない人工知能ライブラリです。なぜなら、Deeplearning4j自体がJavaで記述されているだけでなく、Javaで記述されたオープンソース人工知能ライブラリで唯一、Googleが研究・開発している自然言語処理の手法である「Word2Vec」の研究対象リスト入りしており、ポテンシャルの高さが際立っているためです。

ちなみに、「Word2Vec」とは、「夫婦―夫=嫁」といったように、言葉の概念を連想ゲーム的に足し引きする機能を人工知能に与えることで、より自然に言語をコントロールできるようになるのではないか、というものです。

なお、Deeplearning4jはオープンソースですがSkymind社が商用サポートを行っているため、ビジネス用途の利用にも心強さがあります。画像認識以外にも、電子商取引や広告のレコメンドシステムや、製造業などでの異常検知などビジネスユーズの開発もすでにされています。

3.Apache MXNet

Apache MXNetは、名前から推測できる通り「Apache HTTP Server」などで知られるApache財団が開発を進めている人工知能用ライブラリです。MXNetには面白い特徴があり、ハードウェアリソースが増やすだけで、処理速度が向上し、精度も高まります。

一見、当たり前のことのように思う方も多いかと思いますけれど、通常はハードウェアの増減に合わせて、ハードウェアリソースのコントロールに関するロジックを変更する必要があります。

ハードウェアの変更後、ソフトウェアに手を加えなくてよい、という特徴は非常に画期的で、特にハードウェアリソースの増減が簡単なクラウド環境と非常に相性が良いです。

そのため、Apache財団に資金援助を行っているMicrosoftや、AWSが売り上げの過半数であるAmazonなどのクラウドサービス提供企業からも熱視線を向けられています。

Amazonには「AWS での Apache MXNet」という特設ページも用意されています。MicrosoftやAmazon以外にも、コントリビューター(支援企業)が400以上も存在し、将来性が非常に期待できるライブラリです。

4.Chainer(チェイナー)

Apache MXNetは、名前から推測できる通り「Apache HTTP Server」などで知られるApache財団が開発を進めている人工知能用ライブラリです。MXNetには面白い特徴があり、ハードウェアリソースが増やすだけで、処理速度が向上し、精度も高まります。

一見、当たり前のことのように思う方も多いかと思いますけれど、通常はハードウェアの増減に合わせて、ハードウェアリソースのコントロールに関するロジックを変更する必要があります。ハードウェアの変更後、ソフトウェアに手を加えなくてよい、という特徴は非常に画期的で、特にハードウェアリソースの増減が簡単なクラウド環境と非常に相性が良いです。

そのため、Apache財団に資金援助を行っているMicrosoftや、AWSが売り上げの過半数であるAmazonなどのクラウドサービス提供企業からも熱視線を向けられています。Amazonには「AWS での Apache MXNet」という特設ページも用意されています。MicrosoftやAmazon以外にも、コントリビューター(支援企業)が400以上も存在し、将来性が非常に期待できるライブラリです。

5.Keras(ケラス)

公式サイトの文言を拝借すると「迅速な実験を可能にすることに重点を置いて開発された」ことを売りしているライブラリがKerasです。もう少し具体的に言えばKerasは、「ユーザーフレンドリー」、「モジュール性」、「拡張性」、「Pythonで実装」の四つをガイドラインにおいています。

四つのガイドラインはそれぞれ相互に関連しており、「Pythonで実装」されているため、プログラミング初学者でも扱いやすく「ユーザーフレンドリー」です。

「モジュール性」とは各ロジックが独立した存在であることを意味しますが、各ロジックを自由に組み合わせることができるという意味でもあり、組み合わせ方次第で、様々な人工知能を開発できる「拡張性」に繋がっています。

また、「Pythonで実装」しているため、ロジックか理解しやすく、手を加えやすいという点でも「拡張性」が高い言語です。Kerasのこれらの特徴は開発速度が求められる環境や試行錯誤しながら開発を進めるプロトタイプ開発などで、非常に役立ちます。

6.Torch(トーチ) Pytorch(パイトーチ)

TorchとPytorchの違いをまず確認しておきたいと思います。Torchというライブリはブラジル生まれのLuaというプログラミング言語のためのもので、それをPython用に移行した“TorchのPython API”がPytorchです。

つまり、TorchとPytorchは基本的には同じもので、どちらもライブラリの大半がLuaで記述されています。Luaはゲーム業界で特に広く利用されている言語で、Pythonと同じくくりの汎用スクリプト言語ですが、Pythonやそのライバル言語であるPerlやRubyよりも挙動が高速という優れた長所があります。

FacebookやTwitterなどのSNS業界の大手もデベロッパーとして参画しています。他にも、NVIDIAが参画しているため、やっぱりCUDAのメリット・デメリットを持っています。近年、急速に利用者が増えているライブラリです。

7.TensorFlow(テンソーフロー)

人工知能用ライブラリとしておそらくもっとも知られているのがTensorFlowです。有名な理由はずばり、人工知能開発で第一線を進んでいるGoogleによって公開されているためです。

Python、C言語(C、C++)、Java、Goと多くの言語に対応しており、ハードウェアについても、CPUやCUDAによるNVIDIA _ GPUでのGPGPUはもちろんのこと、スマートフォンでおなじみのSnapdragonを作っているクアルコムから販売されているHexagon DSPやGoogle TPUと呼ばれるTensorFlow用のカスタムチップなど、多様な選択肢があります。

ちなみに、CPUはCPUでもIntel製CPUを使う場合はIntel Math Kernel Library (Intel MKL)というIntelが最適化したライブラリがあり、それをTensorFlowに組み込むことが可能です。さらにモバイル向けのTensorFlowもあり、androidやiOSさらにはRaspberry Pi用のTensorFlowもあります。全方位死角なしのライブラリです。

8.PaddlePaddle(パドルパドル)

中国最大で世界でも第二位の検索エンジン「Baidu(百度)」が主導して開発・公開しているのがPaddlePaddleです。中国は国家として人工知能の開発に非常に力を入れており、人工知能大国です。

その理由として最大のものは一党独裁に人工知能が非常に役立つと考えられているためです。中国の治安機関では、監視カメラの映像とインターネット上の活動を人工知能によって監視することで、犯罪者やテロリストが“凶行”を起こす前に割り出し拘束することで、犯罪のない世界を目指すというSF映画のような治安対策が真剣に検討されています。

すでに、新疆ウイグル自治区では、監視カメラの映像などを使って、自宅と職場以外の場所に行って不審な行為をしていないか人工知能を使って監視していることが示唆されています。このディストピア的な治安対策にPaddlePaddleもなにかしらの役割を担っているのではないかという疑いから、諸外国のIT企業、エンジニアが使うことは滅多にないです。

しかし、他国からの情報を遮断されており、Googleもアクセス禁止のため、TensorFlowも使えない中国国内エンジニアからはPaddlePaddleは非常に人気のようです。

AI開発に欠かせないライブラリについて

人工知能(AI)開発には、さまざまなライブラリが存在します。基本的な数学の適用から、複雑な機械学習のアルゴリズムまで、AIの開発を助ける重要なツールです。AI開発に欠かせないライブラリについて、以下の3つで解説します。

- そもそもライブラリとは?

- 使用用途によってライブラリは異なる

- ライブラリとフレームワークの違い

そもそもライブラリとは?

ライブラリとは、再利用可能なコードを集めたファイルです。特定の機能や手続きを実行するために使われるため、開発者が一からコードを書く作業が短縮されます。ソフトウェア開発における「DRY(Don’t Repeat Yourself)」原則に基づいています。

ライブラリは同じコードを何度も書くのではなく、再利用可能なコードを用いるべきだという考え方です。

使用用途によってライブラリは異なる

AIの開発において使用するライブラリは、開発者の目指す目標や、解決したい問題により異なります。

| 自然言語処理の問題 | NLTK Spacy |

| 画像処理やコンピュータビジョンの問題 | OpenCV PIL |

| 深層学習モデルの開発 | TensorFlow PyTorch |

| 強化学習のアルゴリズム | OpenAI Gym Keras-RL |

| 大量のデータセットを扱う | Pandas Dask |

AI開発におけるライブラリは多種多様で、解決しようとする問題や開発者の経験、好みによります。適切なライブラリを選択し利用することで、開発効率を大きく向上させることが可能です。

ライブラリとフレームワークの違い

「ライブラリ」と「フレームワーク」は、ソフトウェア開発において重要な役割を果たします。しかし、2つとも異なる部分があるので紹介していきます。

ライブラリとは、共通のコードをまとめた再利用可能なコード集です。コードは通常、特定の機能を実行するために設計され、開発者が自由に呼び出します。たとえば、日付操作や数学的な計算、ファイルの読み書きなどに用いられます。ライブラリの使用方法が柔軟で、開発者が必要に応じて選択し、必要な部分だけを取り出して使用可能です。開発者のニーズに対して最大の制御力と自由度を提供します。

一方、フレームワークは、ソフトウェアの特定の部分を作成するための準備済みの構造または「フレーム」を提供するものです。フレームワークは、ソフトウェアの骨格や設計パターンを提供し、開発者が中に自身のコードを「埋め込む」形で開発を行います。フレームワークの主な目的は、一般的な問題を解決し、コードの再利用性を向上させ、開発の複雑さを軽減することです。

AIライブラリは自分に合うのを選ぶことが大切

AIライブラリは、自身が何を達成したいのか、どのようなスキルセットを持っているのかによって、適切なライブラリを選ぶことが重要です。

たとえば、Pythonを主に使用していて、深層学習のプロジェクトを手がけるなら、TensorFlowやPyTorchなどのライブラリが適しています。一方で、Javaでの機械学習が目的であれば、WekaやDL4Jが良いでしょう。

また、自然言語処理に特化したい場合は、SpaCyやNLTKといったライブラリを選ぶことが有効です。

- 使いやすさ

- パフォーマンス

- サポート

- コミュニティ

AIライブラリを選ぶ際には、上記の要素を考慮して自身に合うものを利用してください。

まとめ

今回は、人工知能の開発に使うライブラリについてご紹介いたしました。ちなみに、利用者数という意味ではarXiv という論文データベースでの利用ケース数比較を行うと、2017年末時点では、TensorFlowが一位で、Kerasが二位、三位がCaffeだったそうです。

あくまで論文ベース、つまり研究機関での実績であり、ビジネスユーズとの差があるのはまず間違いないと思いますが、TensorFlowが人気なのはまず間違いなさそうです。いずれにせよ、それぞれ性質が異なり得意不得意がありますので、用途に合ったライブラリ選びが重要です。

ライブラリを実践的に仕事の中で使用して、自分の得意なライブラリを見つけてもいいかもしれませんね。

- 高額案件を定期的に紹介してもらいたい

- 週2日、リモートワークなど自由な働き方をしてみたい

- 面倒な契約周りはまかせて仕事に集中したい

そのような方はぜひ、ITプロパートナーズをご利用ください!

まずは会員登録をして案件をチェック!

.png)